「歴史が見たことのない未来がはじまる」とネクスト・ソサエティの黒字のそばに赤く書かれている。歴史は繰り返すという言葉があったとしても、実際に経験できる未来は個人にとって繰り返して見ることができるほどではないという意味においてはそうかもしれない。著者のP・F・ドラッカーは92才という長寿であり、20世紀の最初からの経験を積んでいる。一読して思うのはその経験の裏づけには大変な説得力があるということである。これは未来書であると同時に歴史書であるということができるだろう。1998年から今年に掛けて書かれた文章を集めている。21世紀の初期を生き抜くために世界の動向を理解するためには必読の書だ。広範な経験が適確に事実を位置づける。アメリカ、ヨーロッパ、アジア、日本の置かれている状況すべてが理解できる。聞くべき言葉、「人間として生きるということの意味は、資本主義の金銭的な計算では表せない。金銭などという近視眼的な考えが、生活と人生の全局面を支配することがあってはならない。」92年の経験が言わせるとすれば単なる奇麗事として聞き逃すべきではないだろう。原題は"Managing in the Next Society"である。上田淳生訳、ダイヤモンド社、2002年5月23日第1刷発行、276ページ、2200円。

最近は仕事の関係もあって知的生産の方法について考え直そうという気持ちになってきた。ArrangeNoteを使うのはPC上の話だ。オフPCではどうすべきか。常にオンPCという考え方もあるが、キーボードとディスプレイの組み合わせの生産性は必ずしも高くない。特にじっくり考えたいとか翻訳をする場合とか、最善とは言い難い。ただ、翻訳の場合はBabylonのようなオンライン辞書は大変便利なので、紙の上でマウスをクリックしたくなるのは困ったものだ。仕方なく紙の辞書を繰ることになる。紙の問題はハイパーリンクが不可能だということになる。そうだとしても最近インターネットからダウンロードしたpdfやps.gzのファイルを1000ページ以上印刷したが、ディスプレイ上だけで読み通すのは難しい。インクジェットプリンタで両面印刷したものをどのように管理するかだ。最初はクリアファイルを買ってきてそれに挿していったのだが、クリアファイルというのは嵩張るので置き場所に困る。挿すのも面倒な作業になるし、大量に使う場合は価格も無視できない。無論最近はメーカー品以外で大分安いものも出回っているが、インターネットから入手した文献の印刷は継続することになりそうだからもう少し頭を使って見ようということになる。そこでおもしろいと思ったのが、製本テープ。印刷した紙を束ねて、ホッチキスで止めて、製本テープで背張りするのだ。これで簡単に小冊子が出来上がる。なかなかセンスが良く見栄えもよい。色も様々にあるので内容によって使い分けすれば分類もできる。何より安価である。35mm×10mのテープがニチバンのもので600円。A4判の小冊子1冊で20円以下ですむ。15枚30ページぐらいだったら普通のホッチキスで綴じることは容易である。クリアファイルだと200-400円ぐらいかかるだろう。製本テープの裏紙には中央にスリットが入っているのでテープをよく伸ばした後、まず片方だけはずして貼り付けるのがコツだ。

note de fileというルーズリーフのファイルを見つけた。マルマン製。A5判、350円。実は京大式カードを久しぶりに使ってみようかと思ったのだが、芸がないなというか、カードというのは持ち歩きに不便なのとカードを整理するツールも必要になる。実際バラバラなのも取り扱いに不便なのだ。時系列の整理という意味ではバラバラにすると検索性が落ちてしまうし、さらにはB6判のサイズも少し小さい感じがする。そこで、A5判のルーズリーフノートの登場というわけ。ルーズリーフだからバラバラにするのも容易だし、そのまま綴じたままで時系列で保存も可能だ。二穴のファイルに綴じやすいように穴も工夫してあるのがこのルーズリーフの特徴だ。ルーズリーフも罫の間隔の違うものや無地のものなどが用意されている。予備のルーズリーフは60枚で170円だから、少し高い感じはするが・・・インクジェットのA4判普通紙が今や1-2円/枚だからね。そうは言っても許容範囲だろう(^^;)

昨日の中国新聞でマーク・ピーターセンが今年の小中学校の国語教科書から漱石の作品が消えたことを嘆いていたが、なんということだろう。難しすぎるということが理由らしいが、馬鹿げた話だ。何を基準に教材を選ぶのだろう。わかりやすいことが基準ではないはずだ。魅力のある教材を作ることが教育の出発点であることは間違いない。次に何が出てくるだろうとわくわくする気持ちを生徒に持たせることができるかどうかだ。同じページにある「広場」には中学校の教諭の方が「学力の低下で最も問題視されるのは実は学習意欲の低下である」と投稿されていた。なぜ学習意欲が低下しているのだろう。学習意欲の低下の原因を教材だけに求めるのは無理があるけれども、是非とも生徒を引き付ける教材を作ろうと努力してほしいものである。わかりやすいことと魅力があることとは当然異なるのだ。

ドラッカーの新著、「ネクスト・ソサエティ」、ベストセラーは買わないのが主義だけど、ドラッカーだから買ってきた。「知識労働者とは新種の資本家である。なぜならば、知識こそが知識社会と知識経済における主たる生産手段、すなわち資本だからである。今日では、主たる生産手段の所有者は知識労働者である。」様々な警句が散りばめられた魅力的な本だ。こういう本を小中学生に読ませたい。

アマゾンから本が届いた。マイナーなものでも結構早く手に入る。Copyrightには2002の数字が付いている。出来立てのほやほやだ。序言の最初から、少し訳出してみた。

機械学習は最近数年間に渡って関心の復活を立証してきた。それは情報産業の急 速な発展の結果である。データは最早欠乏した資源ではない−それは豊富である。 適切な情報を抽出する「知性的な」データ解析手法が必要とされる。この本のゴ ールは機械学習、特にカーネル・クラシファイアのアルゴリズム的、理論的両視 点からの自己充足的な概観である。・・・

インターネットには解析されるべき大量のデータ資源が眠っている・・・

ビデオを借りるのが習慣になってしまったが、相変わらずのながら族。毎回損をしたと思いながらの返却。ようやく面白いじゃないと思う新作に出会った。「メメント」という邦題ではなんのことやらわからないが、記憶とか夢心地という意味。映像表現も新鮮、ストーリーがアレアレと思わせるのがいいね。最後にははっきりわかるんだけどなるほどと思わせるヒントが最初にある。10分間ぐらいしか記憶できなくなってしまった男が妻を殺した犯人を追うという設定なのだが・・・デビッド・ボウイのSomething in the Airも聞かせる。

SOMを調べながら新たな展開に嵌ってしまった。今、Huma Lodhi等の"Text Classification using String Kernels"を読みかけ。ずーっと以前(更新日記を調べてみると昨年の五月)、テキスト・カテゴライゼーションに統計学的な手法を応用するというYming Yangの文献を調べたことがある。AI:CategorizeというPerlモジュールがYangを引用していたからである。lensの作者のDouglas RohdeはYangと同じCMUの出身だが、今はMITなので、たまたま、CBCL(The Center for Biological and Computational Learning)を覗いていると、SvmFu3というソフトウェアがある。Orangeやlensを知って気付いたのだが、SOMだけじゃなくて他の手法にも有用なツールが数多く公開されている。SVMは統計学的な手法として大変有望らしいし、調べてみようというわけだ。

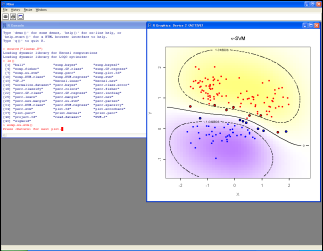

例によってGoogleを使って調べていると、Microsoft Research (MSR) CambridgeのRalf Herbrichにまず辿り着いた。この人の書いた本のサイトLearning Kernel ClassifiersにはLearning Kernel Classifiers Toolboxがある。これはRとCで書かれている。RというのはSという統計解析スクリプト言語のGNU版である。Sは書籍がいろいろと出ているので有名である。早速、Rで使ってみようとダウンロードしてみた。Cygwinを使えばbayes.cなどがコンパイルできる。Rcmd SHLIB bayes.cなどとするわけだけど、/etc/profileでR関連のPATHを通しておこう。SHLIBはPerlスクリプトなので当然Perlは必要だ。Rの最新版1.5.0では動かないので、1.4.1を使おう。サンプルを動かすと次のような具合である。

テキスト・カテゴライゼーションの標準的な方法は、結局、文書中の単語の出現頻度を数えて、いわゆるBOW(the bag of words)を使う。bagというのは繰り返される要素をカウントした集合である。これでは、文の語の順序に関する情報は失われてしまう。前述のHuma Lodhi等の文献は解析のためにテキストの並びを使おうという試みである。bagでもそれなりにおもしろい結果は得られているらしいが、さてどうなんだろう。

豊富な情報が得られることに喜びながらも短時間に消化できないことも明白だ。この調子でいくとインターネットから入手した文献を1000ページぐらいは簡単に印刷してしまいそうだ。KohonenのSelf-Organizing Maps Third EditionもAmazonから既に届いた。SOM関係の文献は既に4000件ぐらいあるらしいが、そのうち2000件弱のリファレンスが100ページにわたって掲載されている(残念ながらダウンロードはできないが(^^;)。SOM文献の20ページ強の概説と同じくらいの分量のグロサリーもある。本体は350ページ、インデックスも含めて全部で501ページ。Springerの情報科学叢書の一冊。HerbrichのLearning Kernel Classifierも昨日AmazonにGNU Octave Manualと合わせて注文した。OctaveというのはMatlab互換のGNUツールである。Newsを見るとこちらは活動を再開したみたいだ。Herbrichの本ではMatlabも使っているので、Octaveで動かしてみようというわけ。支援のためにもマニュアルを購入することにした。サンデープログラマにとってフリーの言語は生命線だからね(^^)GNUはAmazonをボイコットしているみたいなので、Amazonで購入できないかと思ったけど検索するとあっさり出てきた。調べてみるとボイコットの理由はいわゆるビジネスモデル特許だ。なるほど、GNUらしいが、配送料無料は今のところAmazonだけだから・・・後三冊ぐらい欲しい本があるがどうしようかな・・・

ここまで来て、Tcl/TkとRubyを放っておくわけにもいくまいと調べてみた。

Tcl/Tkには本格的なアプリケーションが存在した。さすがGUIを標準で有する強みがあり、ビジュアライゼーションの機能を備えている。KohonenのSOMも取り扱え、サンプルを見事、ビジュアルに表示した。その名はlens、the light, efficient network simulator。Cygwinで動く。指示に従って/Lens(まあ何でもいいのだろうが)にインストールして、/etc/profileに

export LENSDIR=c:/cygwin/Lens export PATH=/Lens:$PATHを付け加え、IEでマニュアルを見たい場合には、/Lens/Src/lensrc.tclの149行目を

set .openManual {/Program\ Files/Internet\ Explorer/IEXPLORE.EXE \

${.manualPage}}

のように変更する。

RubyにはLibNeuralというライブラリがある。これは階層型ネットワークモデルで使うバックプロパゲーションというアルゴリズムのC++ライブラリを移植したもの。

Tcl/Tk日本語チームをほったらかしにしちゃっているが、そろそろ心を入れかえないと(^^;)

Self-organizing mapを追いかけているうちに深みに嵌ってしまった。無論、分類をするための方法は自己組織化マップだけではないことは知っていたし、以前はそちらのほうを調べていてそのままになっていたので、もう少しと探索を進めていると、オレンジを見つけてしまった(^^)これも本格的なチュートリアルとPythonモジュールの説明書があるので実用的に使えそうだ。

AIMA(Artificial Intelligence:A Modern Approach) Python Codeも見つけた。こちらもいけそうな感じ。PythonでSOMはできないかと調べたが、それは見つからなかった。

いろいろおもしろいスクリプト言語系のツールが見つかってきたし、その応用も現実的な気がしてきたので、少し戻ってニューラルネットワークの基礎を勉強しようと坂和正敏、田中雅博著、「ニューロコンピューティング入門」、森北出版、1999年3月18日第1版第2刷、199ページ、2600円を買ってきた。説明が丁寧でわかりやすいし、読みたいことが書いてある。こういう類いの本は何が書いてあるのかよくわからない場合が多い。この本はお勧めかも・・・Self-organizing mapについて原論文のいくつかに当たっているので心当たりの内容がわかりやすいだけかもしれないが、、、、、結局500ページぐらい印刷してしまった。

Tcl/Tkに戻るためにこちらも調べてみるか(^^)

更新日記

更新日記