昨晩(2026-03-19)、買い物の遠回りの帰り途。買い物袋を道に置いて、空に星空ナビを向ける。東の空の例の赤い星を特定するためだ。アルクトゥールス、牛飼い座のα星、赤色巨星。Arcturusをどう読むか、アークトゥルスが優勢かな。{03/13/2026: [天体]北斗七星、北極星}←。

さてさて。2026-02-14の日記:。さてばかりだが、配信の準備が間に合っていない。方法の問題でもあるわけだが。

https://youtu.be/gzv2X2peB4Yエピソード1

00:00 さあ、行きます。 00:10 今日は曇りですね。 00:54 今日も雁が飛んでいってますね。・・・さって 01:27 (皆実線を渡る)エピソード2

02:00 (広島駅行き皆実線ヒロデン) 02:39 さあ・・・こちらも渡らないといけないので、・・・渡ります渡ります。エピソード3

03:36 渡りました。 03:39 まあまあ、行っちゃった。エピソード4

03:43 さあ、雁が飛んできますね。 03:52 今日は図書館帰りの道草日記の178回です。 04:04 今日は2冊本を借りました。エピソード5

04:29 さあって、今日も澄んでますね。エピソード6

04:57 さて、・・・タワービルも少し電気が点き始めてますね。 05:10 駅の方も少し点いてます。 05:20 ただいまの時刻が、えーっと、16時59分01秒ですね。エピソード7

05:38 第一船着き場に釣りをしてますね。 05:50 釣れたの、釣れたのかな。また投げたね。エピソード8

06:52 第一ベンチ到達ですね。エピソード9

07:10 イソヒヨドリかな、色から見たら。 07:12 遠くなので。 07:28 さあ、夾竹桃、・・・・・・この雰囲気はイソヒヨドリですね。エピソード10

07:41 どこまで近寄れるかですね。エピソード11

08:34 (イソヒヨドリに少しずつ近づく) 09:12 ああ、逃げましたね。エピソード12

09:15 さあ、今日は第一船着き場が、釣りをされているので、第二で見ましょう。エピソード13

10:05 1、2、3、4、5、6、7段目に水がかかってますね。水面が来てます。 10:12 1、2、3、4、5、あ、6段目か。 10:19 6、7、8、9は、もう、川底と同じような面になってる。エピソード14

10:47 行きましょう。 10:58 第二山桃ですね。 11:01 第二船着き場の出口、南側出口に第二山桃があります。エピソード15

11:13 クスノキがあって、サルスベリですね。 11:33 ハナミズキがあって、タブノキがあって、 11:42 ハナミズキですね。 11:45 クスノキ。 11:49 サクラですね。エピソード16

11:59 そして、新たに植えられた、何かな、これは。エピソード17

12:15 さあ、第三船着き場ですね。 12:23 いましたね。エピソード18

12:30 見えなくなっちゃった。 12:37 ああ、行っちゃったね。 12:41 あ、まだいた。 12:44 これはハクセキレイだよね。エピソード19

13:25 5段目が濡れてますからね。1、2、3、4、引いてるんでしょうね、今ね。 13:50 さあ、第三。下りてみましょう。エピソード20

14:29 どうも指が入っちゃうね。 14:48 行きましたね。 14:54 まだいたんですね。エピソード21

15:01 さあ、あそこに魚が、魚じゃない、鳥がいるように見えるんだけど、違うかな。 15:13 センサー、センサーかな、あれは。 15:16 ちょっと見に行きましょうか。エピソード22

16:17 何か向こう、白い鳥がいるような気がしますね。エピソード23

16:51 何か缶が浮かんでる、缶か何かが浮かんでる。 16:55 センサーでもないよな。 16:57 カップだな、これは。 17:14 まあ、いつもあるところではないから、おかしいなと思いましたけど。エピソード24

17:38 いましたね。 17:43 ハクセキレイがこちらで飛んできてるからね。 17:46 (イソシギのように見える)さあ、行きましたね。 18:22 さあ、元のところに戻りました。エピソード25

18:25 さあ、第4船着き場ですね。エピソード26

18:49 あれはアオサギか。 18:51 ああ、あそこ(平野橋橋脚)も止まりましたね。エピソード27

19:19 さあ、第2ベンチですね。エピソード28

20:20 さあ、第2ベンチでだいぶ暗くなってきましたけど、 20:25 一人読書会をやりましょうか。 20:30 今、20分ですね。エピソード29

20:32 で、鳥の鳴き声が聞こえますね。(音声には入っていない) 21:17 もうちょっとごめんなさい。(準備中) 21:19 ノイズが入ってきました。エピソード30

22:29 さあ、一人読書会ですね。 22:33 今日も、最近ちょっとブログの方では、 22:42 ブログだけじゃなくて、前回取り上げたのかな。 22:46 ジェフリー・ディーバーのクロスサイド、ロードサイド・クロシーズというのを、エピソード31

22:58 (京橋川西岸上空風景) 鵜と何かが飛んでますね。 23:04 あれは何が一瞬飛んでるのかな。 23:07 鵜とカラスか。 23:10 鵜の後を追いかけたという・・・・・・エピソード32

23:24 (鵜?とカラス?が飛んでいく)・・・・・・さて、途中になっちゃいました。エピソード33

23:57 ジェフリー・ディーバー、ロードサイド・グラス 24:03 の話をしたんですが、 24:05 このシャドウ・ストーカーも、キャサリン、なんだ、キャサリン・ダンス。 24:13 ダンスシリーズの傑作の、ジェフリー・ディーバーの傑作の一つだと、 24:21 ニューヨーク・タイムズかどこかの書評で言われている。 24:26 というので、ちょっと、キャサリン・ダンスシリーズということで借りてみました。 24:34 池田真紀子訳だから、一緒ですね。訳者も一緒。 24:39 これは単行本で、借りました。 24:43 まあ、夜寝る前に今、読んでるんですけど、 24:52 まあ、その世界に入り込んで読めるという意味では、 24:56 まあ、読みやすいんじゃないかなと思います。 25:01 最近、なかなか小説の世界の中に入り込めないことが多いので、 25:06 入り込めるというのはちょっと、まあ、珍しいというか、そういう感じですね。 25:16 まあ、そういうことで。エピソード34

25:32 次がですね、少年が来る、ハンガン。 25:42 韓国の女性作家ですね。 25:45 井出俊作訳ということで、 25:49 新しい韓国の文学のシリーズですね。 26:37 クオン。クオン。 26:46 まあ、ちょっと、クオン。 26:48 クオンっていう会社が、出版社があるんですかね。 26:53 そこの作品ですね。 26:56 そこから出版されてる。エピソード35

26:58 シャドウストーカーの方は、 27:02 これは文芸春秋ですね。エピソード36

27:09 ハンガンさんのは何冊か、これまでも取り上げてると思いますけどね。 27:16 まあ、これも有名な著作なので、ちょっとどんなものか読もうということで、借りました。 27:25 えー、以上ですね。 27:30 一人読書会は以上で、終了です。 27:34 そうですね。エピソード37

28:30 龍と苺の19巻で100年後の世界を描き始めたっていう話をして、 28:37 20巻目も取り上げたんですけども、借りたんですけども、 28:42 結構、100年後の世界っていうことで、最初はちょっと飛躍してしまうんで、戸惑うんですけど。 28:49 でも実際には結構面白いですね。 28:56 まあ、元々当初の計画だったそうで、なるほどと思うような展開をしてます。 29:08 あと21、22を、まあ21を借りる予定にしてます。エピソード38

29:13 さあ、次は第五船着き場ですね。 29:27 あー、灯がだいぶついてきましたね。 29:40 第五船着き場。エピソード39

30:14 さあ、第3ベンチですね、もうすぐ。 30:23 5時24分39秒かな。 31:16 さあ、第3ベンチ到達です。エピソード40

31:37 さて、花がつぼんでますね。 32:02 第一椿。エピソード41

32:07 さあ、第六船着き場ですね。 32:34 さて、行きましょう。エピソード42

33:55 さあ、今日は椿ですね。 34:15 第二椿。 34:16 まあ、白い花が咲くはずですね、ここ。エピソード43

34:21 ハナミズキ。エピソード44

34:53 ここは赤ですね。(第三ツバキ) 34:55 さあ。 34:59 さあ、やっと終わって、第3ヤマモモですね。 35:06 さあ、今日はこれぐらいですかね。エピソード45

35:21 アオサギが飛んでいきましたね、でもね。 35:24 うーん、いないわけじゃない。エピソード46

35:49 さあ、第7(船着き場)。 35:51 あー、ハクセキレイがいましたね。エピソード47

36:01 あー、飛んでっちゃいましたね。 36:07 あー、また向こうへ移動しました。 36:19 ちょっと難しいですけど、近づいてみましょう。 36:26 あー、逃げちゃったね。 36:42 いつもこの上に逃げていきますね。 36:46 今、自転車が来たからね。 36:50 しょうがないね。エピソード48

36:52 さあ、さあ、さあ、さあ、さあ、 37:03 これはナンキンハゼですね。これ、第四ナンキンハゼ。エピソード49

37:53 (御幸橋ヒロデン)さてさてエピソード50

38:21 カラスですかね。エピソード51

38:48 さあ、そろそろ終わりにしましょう。エピソード52

39:02 さあ、ここにハクセキレイがいるから、 39:11 もう、今先いたからね。 39:17 逃げちゃったから。エピソード53

39:49 うーん、魚は、魚の痕跡はなかったですね。エピソード54

40:06 じゃあ、ここで終了しましょう。 40:09 第五ナンキンハゼ。 40:12 第四ベンチですね。 40:14 それでは、お疲れ様でした。 40:17 いつもご視聴ありがとうございます。 40:19 終了します。

冷たい春の雨が降っているというのに、小雨とは言え、傘も差さずに歩いている人も多い。中学生が両手で何かを見ながら歩いているのを追い越すとゲーム機だった。小さな曲がる交差悪路でズリッと滑ったので、危ないよ、雨の中だし止めとけよと思ったが。御幸橋南側の京橋川に向かった。久しぶり。

【日本アカデミー賞】安田淳一が映画監督ならではの視点で選ぶ本とは!?【本ツイ!】 出版区 チャンネル登録者数 22.3万人 9,459回視聴 2026/03/06 #安田淳一 #侍タイムスリッパー #出版(安田淳一 - Wikipedia)を見て、「ドライブ・マイ・カー」を思い出した。Prime Videoで見れたはずと検索して見た。ドライブ・マイ・カー (映画) - Wikipedia。

村上春樹の小説とはだいぶ違うというか、まったく違うという感じ。アントン・チェーホフ - Wikipediaのワーニャ伯父さん - Wikipediaが出てくる。青空文庫、図書カード:ワーニャ伯父さんで読める。神西清 - Wikipedia訳。監督・脚本の濱口竜介 - Wikipediaに興味を持った。

- 更新日記記事の「ドライブ・マイ・カー」検索結果の一部

- [小説]村上春樹 ドライブ・マイ・カー 女のいない男たち (2013/11/10)

- [小説]村上春樹 イエスタデイ 女のいない男たち2 (2013/12/15)

- [小説]村上春樹 木野 女のいない男たち3 (2014/01/13)

- [村上春樹]十夜一冊 第千二百九十夜 村上春樹著「色彩を持たない多崎つくると、彼の巡礼の年」(文藝春秋、2015年) (2017/05/07)

- [村上春樹]「ドライブ・マイ・カー」の映画化 (2021/10/13)

- [映画]「ドライブ・マイ・カー」と「偶然と想像」 (2022/01/13)

著作を少し調べてみよう。「他なる映画と 1, 2」を借りる予定。

日々過ぎ去り。さて、とにかく前進しつつ。2026-02-15の日記: 買い物途。買い物途動画も連続動画収録になりつつある。発話字幕を残すために。

https://youtu.be/m5weIU8L7Y8エピソード1

00:00 さぁ、夜の散歩です。ナイトウォーク。エピソード2

03:06 (皆実町六丁目交差点方面)エピソード3

03:55 さて、さてとか言ってますけど、ただ買い物に向かってるだけの、 04:20 今日はキャベツ、ブロッコリー、ほうれん草の3点セットで、 04:31 野菜3点セット、珍しく切れてしまって、朝で切れてしまったので。 04:39 ほうれん草とか昼だっただけなんで。エピソード4

04:42 まぁ、いつもタワービルって呼んでますけど、道草で。 06:48 こんなに近くに見えるんですね。 06:52 まぁ、すぐ近くです。エピソード5

07:10 皆実町六丁目交差点です。 07:15 向こうが御幸橋です。エピソード6

08:02 人通りが多いと道草はできない。 08:06 なかなか録画しながらの道草はできないんで。 08:14 人通りの、 08:17 まぁ、いつもの道草に行ける経路は人通りが少ないので、 08:23 成り立つんですけどね。 08:27 さぁ、ここは夜、夜でないと。 08:31 人通りが。エピソード7

08:49 さぁ、行ってきましょうか。エピソード8

09:23 来ましたね。・・・・・・グッドタイム。エピソード9

09:53 さて今日は、ちょっと通して、録画してみましょう。 09:58 強くなりましたね。エピソード10

12:53 木星が見えてる。 13:46 木星が見えましたね。 13:47 曇ってるから、今日が。 13:49 星はちょっと、 13:51 難しいかなと思ったんですけどね。エピソード11

13:54 さて、ただいまの時刻、19時58分16秒。エピソード12

16:26 さぁ、最後ですかね。 16:35 さぁ、これで、 17:06 最後にしましょうか。エピソード13

17:11 じゃあ、ここで終了しましょう。 17:44 はい、お疲れ様でした。 17:46 17…

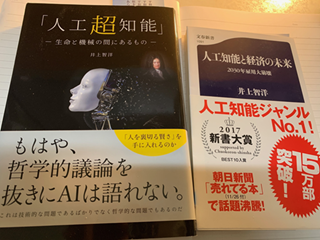

井上智洋著書蔵書

井上智洋氏にはJavaの著作もある。経済学は数学でもあり、シミュレーションでもあるからだろう。プログラミングは不可欠だ。しかし、哲学はそんなに簡単ではない。

- 『「人工超知能」 −生命と機械の間にあるもの−』(秀和システム, 2017年)

柄谷行人の「隠喩としての建築」(講談社、1983年)を基礎に西垣通の「ビッグデータと人工知能」(中央公論新社、2016年)を切っ掛けにして書かれたという。今書くなら西垣通著「デジタル社会の罠」(毎日新聞出版、2023年)を読むべきだろう。生成AI/LLMが登場した今となっては、内容的に物事を単純化し過ぎているように感じてしまう。

- 『人工知能と経済の未来 2030年雇用大崩壊』(文春新書, 2016年)

- 『新しいJavaの教科書』(ソフトバンククリエイティブ, 2006年)

先に進む必要がある。

途中で道草184に出たが、帰宅して終盤を見た。今、感想戦。息を飲んでいたのは藤井棋王かもしれない。

第一局が衆院選投票日({02/08/2026: [日記]文学フリマ広島8、道草176の帰り道 - 南天や 雪の重みに 撓みけり}←)だったが、{03/09/2026: [YouTube]道草176 雪の道草ポストエピソード}←で、第一局の結果を単に伝えるとネガティヴ評価が三つ付いたので、説明欄に「(追記: 2026-03-10) 藤井竜王名人は大変ですね。増田康宏八段とのNHK杯決勝戦は藤井竜王名人の勝利に終わりました。棋王戦第二局は藤井棋王が勝ち、第三局は負け、第四局は3/15(日)に行われます。王将戦は藤井王将が第五局に勝って、二勝三敗、カド番は継続するも、永瀬拓矢九段との王将戦第六局は3月18・19日に行われます。」を加えると、ネガティヴ評価をすべて消していただいた。視聴者はよく見ておられる。説明欄は大切だと再認識。ポイントと思うことは記載することに。リアルの発話による字幕だけで動画の意味を表すことはできない。

藤井棋王の勝利に終わり、二勝二敗。第五局は3/29、鳥取市の有隣荘で行われる。

今晩は、天頂から北や東の空を見上げながら夜の買い物から帰った。昨日のナイトウォークも風が強かったが、今日も強い。春一番か二番か・・・天頂には一番明るい星、木星だろうね。傍にカストルとポルックスらしき二つの明るい星がある。代わって、東の空には明るい赤い星がある、火星かな。でも少し暗いし瞬いている。オリオン座はどこに行ったのだろうと探していると、北斗七星を見つけた。北極星もわかった。少し調べよう。

iPhone XRの星空ナビのアプリはわかりにくい。画面が小さいせいか、画面が夜空を見る視覚的直感に合わない感じがする。StarWalk2を入れてみた。ズームができるらしい。試してみよう。アプリもまどろこしい感じもするので、雑誌の「星ナビ」を一度購入してみることにした。大昔なら天文ガイドや天文年鑑を買っていたが。

2026-02-19,20(JST)に配信した道草173(2026-01-28の日記:)にアナリティクスの地域の詳細から2/19(PST)に海外から10%弱のアクセスがあったらしいことがわかった。2/18にインドネシアからのみ83、2/19に米国から374、その他ドイツ、フィリピン、インドネシアなどからアクセスがあった。通常は海外からアクセスはない。

Gemini3によれば、YouTubeのアルゴリズムが{道草173 - 動画の文脈を辿る (2026/02/21)}←の下記の部分に反応したらしい。ショートの字幕は自動なのでまともに英語になるかどうかは怪しいけど。今直しといた。

Gemini3はこちらの入力に合わせて、蓋然性みたいなもので語るだけなので、事実かどうかは別問題だ。妥当かどうかは自分自身で判断する必要がある。人間であっても同じようなものだが・・・

https://youtu.be/RNh4bVhgvLk 02:17 レイ・ダリオという人の、世界秩序の変化に対処するための原則、なぜ国家は興亡するのか、これを今日は借りてきたので、一冊返して、一冊借りまして、借りてきました。 02:43 日本経済新聞の出版から出てますね。 02:47 これ最近、YouTubeなんかでもこの人のことが話題になってて、 02:54 それで興味を持って、伝説的投資家で、世界的ベストセラー「プリンシプルズ」の著者レイ・ダリオは、 03:13 半世紀以上をかけて、世界各国の経済とマーケットを調べてきたと。 03:19 その彼が過去500年に起きた政治的経済的の激変を研究して、現在に生きる人々が経験したことのない、 03:28 根本的変化が将来発生しうることを解説すると。 03:35 そういうふうなことですね。 03:39 うーん・・・何が書いてあるんでしょう。まあそういうことで、今日はこの一冊ですね。 03:49 まあまた、中身で関心があれば、また何か言うかもしれません。

尤も、要点はアナリティクスのシステム時刻はYouTubeのサーバーのあるPST/PDT(太平洋標準時)だということらしい。太平洋標準時 - Wikipedia。もちろん配信時刻はJSTということ。インドネシアはUTC+7〜+9のインドネシア時間(インドネシア - Wikipedia)のようだが。フィリピン - WikipediaはUTC+8。2/18のインドネシアからのアクセス83の意味がよく分からない。他からのアクセスは2/19に集中している。日本 - Wikipediaの時間帯はUTC+9。PSTはUTC-8。

| 地域 | 視聴回数 | 平均視聴時間 | 総再生時間(単位: 時間) |

|---|---|---|---|

| 合計 | 148,778(100%) | 0:15 | 231.3(100%) |

| 日本 | 145,942(98.1%) | 0:14 | 222.6(96.3%) |

| アメリカ合衆国 | 374(0.3%) | 0:17 | 0.9(0.4%) |

| インドネシア | 166(0.1%) | 0:13 | 0.2(0.1%) |

| フィリピン | 160(0.1%) | 0:13 | 0.2(0.1%) |

| ドイツ | 79(0.1%) | 0:12 | 0.1(0.1%) |

| タイ | 54(0.0%) | 0:12 | 0.1(0.0%) |

| イギリス | 49(0.0%) | 0:15 | 0.1(0.1%) |

| カナダ | 36(0.0%) | 0:11 | 0.0(0.0%) |

| インド | 32(0.0%) | 0:18 | 0.1(0.0%) |

| オーストラリア | 30(0.0%) | 0:12 | 0.1(0.0%) |

| マレーシア | 26(0.0%) | 0:12 | 0.1(0.0%) |

| 台湾 | 25(0.0%) | 0:14 | 0.1(0.0%) |

| ベトナム | 22(0.0%) | 0:15 | 0.1(0.0%) |

| ロシア | 20(0.0%) | 0:29 | 0.1(0.0%) |

| 地域 | 視聴回数 | 平均視聴時間 | 総再生時間(単位: 時間) |

|---|---|---|---|

| 合計 | 149,252(100%) | 0:15 | 232.8(100%) |

| 日本 | 139,368(93.4%) | 0:14 | 211.6(90.9%) |

| アメリカ合衆国 | 388(0.3%) | 0:17 | 1.0(0.4%) |

| インドネシア | 166(0.1%) | 0:13 | 0.2(0.1%) |

| フィリピン | 160(0.1%) | 0:13 | 0.2(0.1%) |

| ドイツ | 79(0.1%) | 0:12 | 0.1(0.1%) |

| タイ | 54(0.0%) | 0:12 | 0.1(0.0%) |

| イギリス | 49(0.0%) | 0:15 | 0.1(0.1%) |

| カナダ | 36(0.0%) | 0:11 | 0.0(0.0%) |

| インド | 32(0.0%) | 0:18 | 0.1(0.0%) |

| オーストラリア | 30(0.0%) | 0:12 | 0.1(0.0%) |

| マレーシア | 26(0.0%) | 0:12 | 0.1(0.0%) |

| 台湾 | 25(0.0%) | 0:14 | 0.1(0.0%) |

| ベトナム | 22(0.0%) | 0:15 | 0.1(0.0%) |

| ロシア | 20(0.0%) | 0:29 | 0.1(0.0%) |

計算が合わない感じだけど・・・3/13に米国から14のアクセスがあった。この記事への反応かな^^)/~~

2026-02-11の日記。さらに前進。久しぶりにjperlを弄った。ループを制御して「エピソード数」行を出力するように。YouTubeのエピソード番号は運用上のミスで、00から始まっている。フォントのColorの同じコードを選択すると切り出し動画が出力されないことに気付いた。{追記(2026-03-14): ショート動画のエピソード数は付け直した。後からプログラミングする場合、例外があるとややこしいから。チャプター・エピソードリストに合わせた。検索は基本的には更新日記とデスクトップで間に合うようにしたい。}

https://youtu.be/8t6h8WH4yK8エピソード1

00:00 さあ、行きます。 00:05 今日は曇りで、ああ、たくさん飛んでますね。 00:26 さあ、行きましょう。 00:29 図書館帰りの道草日記の177回です。 00:38 あー小雨が、ちょっとちらついてますね。エピソード2

00:48 さあ、行きましょう。(皆実線ヒロデンが二号線を渡る) さあ、行こう行こう。エピソード3

03:43 今日は気温は、そんなに低くないと思いますね。 03:47 9度か、8度か。 03:50 出るときは10度ぐらいだと思います。 03:53 ただ、また明日は寒くなる予報ですね。 04:01 でも、明日だけだと思います。エピソード4

04:03 今日は透明ですね。 04:22 魚は、ちょっといませんね。 04:29 まあ、今ちょうど、干潮と満潮の境ぐらいですかね。 04:42 潮が入り乱れている感じがします。エピソード5

04:48 来ましたね。エピソード6

05:52 あのビルは、タワービルはあれですね。エピソード7

05:59 目の前を飛んでいきますね、鳥たちが。エピソード8

06:12 次から次へと。エピソード9

06:40 これは鵜です。 06:43 これは鵜です、一羽は。 07:18 この下は鵜ですね、これも。エピソード10

07:28 いくらでもやってくる。 07:30 ちょっともう、これぐらいにしておきます。エピソード11

07:34 どんどん通っていって。 07:37 通り道。 07:43 さって。 07:45 どうでしょうか、今日は。 07:48 ただいまの時刻が、17時14分55秒です。 07:52 ですね。エピソード12

08:01 何か、鵜が後から飛んでいく図が、続いてますね。 08:25 うーん・・・まあ、いいでしょう。 08:34 さあ、第一船着き場。エピソード13

08:37 平野橋から、第一船着き場です。 09:40 去年も、こんなことがあったのかな。 09:44 これは、去年も撮った記憶があるので。 09:53 この第一船着き場から、撮った記憶がありますね。{02/12/2026: [日記]昨年の今頃 - 道草91の野鳥たち}←。

- 道草91ピックアップ1 - 雁行にびっくり!

- まだ続けて雁が飛んでくる。第八船着き場、第四ベンチ到着にて終了!

- 遅れた雁たちがまたグループを作りながら飛んでいく

- 第三ツバキ、枯れたアジサイ、ヤマモモを見ていると、空に異変。雁が飛んで来た。次から次へと

エピソード14

09:56 今日は、1、2、3、4、5、6段目にかかってますね。 10:12 6、7、8、9。 10:14 1、2、3、4、5、6、7、8。 10:22 9は、もう、川底と一緒になってる感じに見えますね。エピソード15

10:58 何か、白いカモメかな。 11:03 一羽いますね、おそらく。 11:07 西岸の方にいますね。エピソード16

11:19 行きましょう。 11:24 第一ベンチ、到着ですね。エピソード17

12:17 夾竹桃の、・・・・・・第二船着き場ですね。 12:47 さあ、第二ヤマモモですね。 12:49 もう、明かりがついてますね。エピソード18

12:56 さあ、サルスベリ。 13:22 花水木。 13:27 タブノキ。 13:28 花水木。 13:34 クスノキ。 13:36 サクラ。 13:37 と、並んでいます。 13:46 で、これが、新たに植えられた。エピソード19

13:48 さあ、第四船着き場ですね。 14:08 違うか、第3か。 14:10 第3船着き場ですね。エピソード20

15:13 花水木、花水木。 15:16 クスノキ。 15:22 ナンキンハゼですね。 15:26 そして、花水木。 15:27 サクラ。 15:37 サクラ。 15:42 タブノキ。 15:45 クスノキ。 15:46 これは、花水木ですね。 16:04 そして、第四船着き場です。エピソード21

16:16 あ、鵜がいましたね。 16:42 珍しいですね、潜らないのは。 17:23 さあ、第四船着き場ですね。 17:47 まだ、ずっと潜らずに。 18:27 どうするんだろう。 18:52 珍しい。エピソード22

18:53 第3ベンチ。 18:59 いや、第2ベンチ到達ですね。エピソード23

19:26 ありゃりゃ、・・・・・・ありゃりゃ、・・・・・・羽を、羽を乾かしています。 20:43 羽を乾かしに行ったんですね。 21:17 なるほど。 21:19 だから潜らなかった。エピソード24

鵜が長い間潜らないのでおかしいと思っていたら、案の定、西岸の船着き場に上がって羽根を乾かし始めた。しかし、なぜか遊歩道のほうまで上がっていった。たまたま走ってきた人間に驚いて土手の川に掛かった樹木に引っ掛かりながら川に落ちた。おそらく人も驚いたろう。落ちた後の状況は東岸のこちらからは良く見えなかったのだが、ビデオを見ると船着き場の前をまた泳いでいた。

21:21 ああ、羽を広げましたね。 21:48 上の方に上がっていってるね。← ここら辺から見ると良いが、カメラが引いたとき落ちるのでよく見ないとわからないです。 22:07 さあ、一番上まで上がっていった。 22:20 ああ、ここから見えなくなっちゃった。 22:39 落ちた。 22:41 今、人が来たから。 22:43 人が来たから、落ちてしまった。 22:46 逃げた、慌てて逃げた。 22:48 まあ、せっかく乾かしたのに。乾かそうとしても。 22:54 どうするんだろう。 23:05 出てこないな。 23:25 ついでに、食べ、何か食べてこい。 23:27 捕まえようってことになったのかもしれませんね。 23:31 うーんエピソード25

23:36 さあ、・・・・・・ハクセキレイですね。 24:00 ハクセキレイの鳴き声が。エピソード26

24:09 さあ、第五船着き場ですね。 24:32 鳥が、雁が飛んでいったんですけど。エピソード27

25:07 さあ、第3ベンチ到達です。 25:41 何か忘れ物がぶら下がっています。エピソード28

25:49 今日は、本は返しに来ただけなので。 25:57 今ちょっと、大岡信の、まことかな。 26:06 折々の歌に、ちょっと最近、また関心が出てきて、折々の歌を見直してますね。{02/13/2026: [文学]折々の歌 - 道草、ナイトウォーク、悲しみの間に間に}←。

エピソード29

26:19 これは、鵜ですよね。これも。 26:35 鵜がかなりいますよね、ここは。 26:58 しょっちゅう飛び交ってますね、上空。 27:06 まあ、川にもいるんですけど。エピソード30

27:13 さあ、第六船着き場到着ですね。 27:21 ちょっと、降りましょうかね。降りてないので、今日は。 27:29 いや、鳥がいたらいけないと思って、ちょっと回り込んだりしてたんですけど。 27:34 残念ながら、今日はいない。 27:37 1、2、3、4、5、6。 27:40 1、2、3、4、5、6、7。7か。 27:45 ここで、水面が来てますから。 27:48 ちょっと、引いてるんですかね。 27:50 引いてる感じですね。エピソード31

27:52 まあ、ちょっと降りてみましょう。 28:03 少しあの、緑の藻が、最近ちょっと目立ちますよね。エピソード32

28:17 おっととと・・・ヨロヨロしてる。 28:19 綺麗な模様ができるんですね。 28:52 これですね、こんな感じで。 28:59 これを、1、2、3、4、4段目ですね。エピソード33

29:27 1、2、3、4、5、6、7、8、9。ここは、9段目が見えますね。 29:34 9段目が、川底、底と分かれてるのが分かります。エピソード34

30:01 (第六船着き場石畳からの風景)エピソード35

30:26 これ、謎の物体。雪が、雪の日は雪が積もってました。エピソード36

30:46 さあ、第6を過ぎて、もう終点ですね、もうすぐ。 30:57 もう、第3ベンチ過ぎてます。エピソード37

31:05 何かあそこ、跳ねたね。エピソード38

31:31 第二・・・ツバキですね。 31:48 うーん、まあ、まだ、咲かない。エピソード39

32:01 第3ツバキの赤いのが、・・・・・・クローズアップ・・・・・・エピソード40

32:49 さて、さっきの鵜は、どうしたかな。エピソード41

33:11 第7船着き場です。エピソード42

33:50 ここは、花水木がずっと並んでますね。 34:22 ここ、タブの木があって。エピソード43

35:06 (御幸橋ヒロデン)エピソード44

35:23 そろそろ、終わりにしますかね。・・・・・・第4ベンチも人がいますね。 36:09 自転車が止まってる。 36:21 止まって、一生懸命スマホで、いろいろ見てるんですよ。 36:26 そういう人も多い。エピソード45

37:03 あー・・・・・・いましたね、今。 37:08 これは、ハクセキレイですけど、もう一つは、もう一羽、別の鳥がいましたけど、逃げちゃいました。エピソード46

37:34 (御幸橋ヒロデン)エピソード47

37:47 うーん・・・・・・1、2、3、4、5、6。 38:09 あれ?・・・1、2、3、・・・4、5、6。 38:13 6段目まで、ここは、水がきてるな。 38:15 7、8。 38:16 1、2、3、4、5、6段目ですね。 38:20 こんな、満ちてるのか。 38:22 7、8、9。 38:29 9まで、見えますね、ここは。エピソード48

38:35 さあ、・・・・・・では、ここで、終わりにしましょう。 38:54 じゃあ、ここで、終了しましょう。エピソード49

38:58 本日も、ご視聴ありがとうございます。 39:00 お疲れ様でした。 39:03 失礼しまーす。 39:06 ご視聴ありがとうございました。

{道草175ショートエピソード配信の遅滞・混乱 (03/02/2026)}←、道草175ショートエピソード9-18の配信がうまくスケジュールできなかったので、再度、ごろにゃんくんの解説付きにして再配信中。チャンネルの通知は最初の3本/日まで、10本公開/24時間の制約のなかで配信する必要がある。どこまでショートフィードに載るかが問題になる。チャンネル通知のプッシュがないと難しい面がある。

- 道草175ショートエピソード9 - ごろにゃんの冒険1 #散歩 #日記 #ごろにゃん

- 道草175ショートエピソード10 - ごろにゃんの冒険2 #散歩 #日記 #ごろにゃん

- 道草175ショートエピソード11 - ごろにゃんの冒険3 #散歩 #日記 #ごろにゃん

- 道草175ショートエピソード12 - ごろにゃんの冒険4 #散歩 #日記 #野鳥 #ごろにゃん

- 道草175ショートエピソード13 - ごろにゃんの冒険5 #散歩 #日記 #野鳥 #ごろにゃん

- 道草175ショートエピソード14 - ごろにゃんの冒険6 #散歩 #日記 #野鳥 #ごろにゃん

「ごろにゃんの冒険」という小説を書こうと思っていたのだが、道草に登場することになった。「ごろにゃんと散歩」ということにならないかと念じて、タイトルを変更した。このほうが相応しい。

- 道草175ショートエピソード15 - ごろにゃんと散歩7 #散歩 #日記 #ごろにゃん

- 道草175ショートエピソード16 - ごろにゃんと散歩8 #散歩 #日記 #ごろにゃん

- 道草175ショートエピソード17 - ごろにゃんと散歩9 #散歩 #日記 #野鳥 #ごろにゃん

- 道草175ショートエピソード18 - ごろにゃんと散歩10 #散歩 #日記 #野鳥 #ごろにゃん

道草176 雪の道草エピソード 39 #散歩 #日記 #野鳥 #ごろにゃん。ハクセキレイのよく映ったエピソード39がたまたま配信がうまくいかなかったので、それをベースに作って配信してみた。

「吾輩は猫である」の朗読も検討してきたが、余裕がまだないと言いながら、いろいろ考えようと思っている。ストーリー(動画文脈による分節化)を発話の字幕をベースにして編集してきたが、説明があったほうが意味付けできる分節が存在していることが次第に見えてきた。猫を道草の先導役、あるいは説明役にしたら面白いのではないかと試そうとしている。

ごろにゃん

ごろにゃんNano Banana/Gemini3で「三毛猫で黒と黄色、白が混じっている。黄色が主体だが、黒も目立つ感じ。」、「かわいくて控えめなのがいいですね。出会うと「にゃん」と鳴きますがなれなれしくはない。」と頼んだものの一つの画像から、GIMPで切り出し、背景を消して透過画像にしたもの。

ごろにゃんの由来は図書館帰りの道草日記 82 買い物帰りの道草編 - 猫にからまれる、夜空の大三角形を見上げていると。(2025-01-12の日記:)にあるのだが、モデルは第二世代の可能性が高い。

from moviepy import VideoFileClip, ImageClip, CompositeVideoClip, TextClip

# 1. 素材を読み込む

video = VideoFileClip("story_24fcff_p1.mp4")

# 2. 猫の準備(既に成功している透明化コード)

img_clip = ImageClip("goronyan1transp.png")

cat = img_clip.with_mask(img_clip.to_mask())

cat_clip = (cat.with_duration(7)

.with_start(2)

.with_position(("right", "bottom")))

# 3. テキストの準備

# TextClipは非常に重いため、合成前に短く設定する

text = TextClip(

text="はじめまして、にゃん!",

font="C:/Windows/Fonts/msgothic.ttc",

font_size=40,

color='white'

)

text_clip = text.with_start(2).with_duration(7).with_position(("right", 800))

# 4. 合成:リストを明確にする

# 重要な点:動画自体の長さを超えないように注意します

final = CompositeVideoClip([video, cat_clip, text_clip], size=video.size)

final = final.with_duration(video.duration) # 合成後の動画の長さを明示的に動画ファイルと合わせる

# 5. 書き出し:高速化オプション

final.write_videofile("goronyan_final.mp4", codec="libx264", audio_codec="aac", fps=24)

まともに動くまでかなり苦労した。10近いバージョンを試したはずだ。こういうスクリプトはノウハウの塊。朝、ふと思って、Gemini3に相談して、他の選択肢も当然あるわけだが、サービスを使うのは面倒くさい。おそらく自由度に乏しい。自分で作るならスクリプトだと始めて、既に配信済みだ。GIMPの使い方もGemini3に聞いて、背景を消して透明化の処理を自分でした。できることはわかっていても、自分で方法を調べていたらあきらめていたかもしれない。生成AI/LLMの有用性は間違いないところだ。もちろん、対話がキーなのだが。ここがどうしてもブラックボックス化されるというか、応用することができるような説明が難しい。出力は結果に過ぎない。プロセスは対話そのものになる。人間も一種のLLM、モナドだ。生成AI/LLMは集合知、一種のメタ・モナドだ。対話のプロセスを通じて調和が計られる。出力は調和の結果だ。

さらに前進。道草176はここまで。

https://youtu.be/R6oV2VqxArY 00:00 棋王戦第1局が終わったので、ようやく投票に来ました。 00:14 すごいね。投票済みです。 00:25 これは大変だ。大変だ。 00:28 雪国だったら、超大変でしょう。 00:37 これは大変な選挙になりましたね。 00:56 雪が降り続いたんです。白い樹木になっちゃいましたね。 01:38 藤井聡太棋王が第1局は負けましたね。 01:43 増田さんが勝ちました。(追記: 2026-03-10) 藤井竜王名人は大変ですね。増田康宏八段とのNHK杯決勝戦は藤井竜王名人の勝利に終わりました。棋王戦第二局は藤井棋王が勝ち、第三局は負け、第四局は3/15(日)に行われます。王将戦は藤井王将が第五局に勝って、二勝三敗、カド番は継続するも、永瀬拓矢九段との王将戦第六局は3月18・19日に行われます。

02:02 手が冷たい。 03:09 3分過ぎていた。 03:10 うん・・・・・・うーん・・・・・・まあ、これぐらいで終了しましょう。 03:47 はーい、終了。おやすみなさい。

前進。

https://youtu.be/4OrMdXkvCC4 00:00 あっ、止めてしまった。 00:02 うっかり止めてしまった。 00:12 うっかり止めました。 00:14 ああー 00:16 ハクセキレイを最後に詳細に捉えることができたね。 00:27 もう、あーもう、遠くが見にくくなっていますね。 00:35 また強く降ってきました。 00:38 積もるんでしょうか。 00:40 第4ベンチ、第8船着き場、第4ベンチ到達です。 00:44 第五ナンキンハゼですね。 00:58 ちょっと御幸橋を渡っていって、下がどれくらい見えるか見てみましょう。 01:29 これもナンキンハゼですね。 01:36 これもナンキンハゼなので、 (御幸橋を東から少し渡って上流を見る) こんな感じで終わりましょう。 02:12 ありがとうございました。

COURRiER 2026.3.7 村上春樹が米紙に語る「病からの復活」と「小説を書くということ」- 新作長編の主人公は若い女性(ニューヨーク・タイムズ(米国)Text by Alexandra Alter)。Alexandra Alter - The New York Times。

「プランは何もありません。ただ書いているだけ。すると奇妙なことが、ごく自然に、ひとりでに起こるんです」ということになる。一種の無意識的LLMのような感じ。大江健三郎も頭に降りてくるという。そのようになれば小説が完成できると確信するという話をどこかで語っていた。

プランはないと言っても、「あと何冊、小説を書けるかはわかりません。でも、まだまだ書ける気がしています。小説を書くというのは本当に素晴らしいことです。自分自身を探検するようなものですから。歳をとっても、探るべき場所がまだ残っているんです」ということなので、「探るべき場所」はあるわけだ。自分の無意識との対話なのだろう。表現は違うが村田沙耶香にも同じような能力がある。{変な話を書いている:超天才、村田沙耶香 (2026/01/02)}←。

突然AIの話題が戦争そのものになる。Claudeも戦争に巻き込まれた。作戦の立案などもAIが導き出す。Open AIが代わりを務める契約を結んだのだとか。なぜアメリカ政府はAnthoropicを切り、OpenAIを選んだのか? テスラジオ チャンネル登録者数 6030人 4,721回視聴 2026/03/04 ☆彡 メンバー優先で 2026年3月3日に公開 最新技術を楽しく学ぼうテスラジオ(TESRADIO)。それはともかく、明日返却しないといけないので、今村翔吾+立沢克美の「イクサガミ」第2巻を読了。なかなかの傑作かも。

小説現代2025-11(Nov.)には「外伝 イクサガミ 無」、Netflixイクサガミ主演の岡田准一と今村翔吾との対談などがある。

チョムスキーもどうしているのかな。「AIは危険ではない。使い方の問題に過ぎない。最も危険なのは人間だ。」{「AIを冷蔵庫を恐れる以上には恐れない。AIの潜在的な問題は社会でAIを如何に我々が使うかということだけである。私は人工知能よりも人間知能を信頼しない、なぜなら、それは非常に人工的だから。」: 04/06/2024: [言語]CHOMSKY.INFOとChatGPT、そしてEverett}{同じことを繰り返す日々 (2025/03/17)}←の言いかえだが、僕の頭の中で過激に変換されている。

- {図書館駆動型読書論関数的 (2024/05/24)}←

- {02/01/2026: [日記]「0の裏側」と「基礎的場としての普遍意識:量子物理学と非二元哲学の理論的架け橋」}←

- {02/24/2026: [A.I.]AIに魂を吹き込む}←

もう一度、考え直さないと足りないか?

【週刊AI】AGIの軍事利用は止めることができるのか?AI企業の国家安全保障との付き合い方を考える The WAVE TV【AIの独自解説チャンネル】 チャンネル登録者数 9800人 2026/03/07が同じ話題を取り扱ってわかりやすくかつ続報的。イラン攻撃の深層‥AIד同時着弾作戦”/ハメネイ師殺害の陰で 情報機関はどう動いた?【3月6日(金) #報道1930】 TBS NEWS DIG Powered by JNN チャンネル登録者数 320万人 88,602回視聴 10 時間 前に公開済み 3月6日(金)に放送されたBS-TBS「報道1930」の番組内容を配信します。にも詳しい。ウクライナで最初に試され、ベネズエラで利用し、イランで本格的に応用されたのだとか。AIの進化と軌を一にしている。

Apple TV+で最初に見たTVシリーズは「テヘラン」だった。今、シーズン3が配信されているが。イスラエルのモサド・米国CIAとイランの革命防衛隊とのはざまで苦悩する女性スパイ・天才ハッカーだ。最早、現実なのか、幻想なのか・・・

- 更新日記記事の「テヘラン」検索結果

- [Jazz]十夜一冊 第千百十夜 中上健次著『路上のジャズ』 (2016/09/17)

- [小説]情報生産者になる 探索編 (2020/12/01)

- [小説]情報生産者になる 探索編 2 - 下調べ (2020/12/02)

- [TV]An Apple Original: レポーターガール (HOME BEFORE DARK) (2020/12/26)

- [将棋]第80期名人戦 七番勝負 第三局 一日目および二日目 - メディアミックスを見る (2022/05/08)

- [日記]日々のこと - 想像力の問題 (2022/08/05)

- [Video]CITADEL (2023/05/06)

{追記(2026-03-08): 【OpenAI vs 国防総省】アルトマン「軍事作戦に関与できぬ」倫理論争が暴いたAI企業の『分断』(望月博樹 によるストーリー)}。

{追記(2026-03-09): OpenAIのロボット部門責任者がアメリカ国防総省との物議をかもす合意に反発して退職(GIGAZINE)}

自動化は思うように進行しないので、できることからやるのが現実的。アップロードするだけなら、この程度の分量なら手動でもそれほどの手間でもない。

{02/08/2026: [日記]文学フリマ広島8、道草176の帰り道 - 南天や 雪の重みに 撓みけり}{03/04/2026: [YouTube]道草176プレエピソード1,2}←続報。

https://youtu.be/hN4OuVDGpNM ---Episode 1--- 00:02 今日は雪です。図書館帰りの道草日記の176回です。傘を差します。 00:33 危ない、滑りそう・・・・・・さあ、雪が積もってます。・・・さあ、二号線を渡りましょう。さあさあさあ。 ---Episode 2--- 01:18 (雪の皆実線ヒロデン) あー、ちょうど行きました。 ---Episode 3--- 01:28 さあ、転ばないようにしよう。危ない、危ない。ちょっとここは登り坂になって、まあ風が結構強いですね。 ---Episode 4--- 02:42 初めてですね、この雪道を、図書館帰りの道草日記で始めてます。 03:01 今朝はちょっと降ってたんです。ちらちらと舞っていたんですけど。 03:14 さっき、出ようと、外に行こうと思ったら、雪が積もってたんです。びっくりして。やー・・・やれやれ ---Episode 5--- 03:35 透明度は高いですね。うーん、魚はいないような感じですけどね。 ---Episode 6--- 03:57 雪景色。津軽海峡冬景色じゃないけど、道草日記冬景色で、ナンキンハゼも雪景色です。 04:24 さあ、土手も完全に白いですね。 04:36 やれやれ、クスノキも、ヤマ、第一ヤマモモも冬景色。 ---Episode 7--- 05:00 さて、どうしましょうか。 05:11 まあ、せっかく来てるんだから。 05:16 降りてみないと。雪は積もってないので。 ---Episode 8--- 05:22 まあ、完全に底まで見えてますね。 05:33 1、2、3、4、5、6段目に水面が来てますけど、7、8、9まで、底まで見えてます。 05:44 よし、よし、よし、よし、よし。 ---Episode 9--- 05:48 まあ、片手なので、青のりがついてますね。 06:22 2段目も。 06:24 2、3、4、5、6段目も。 ---Episode 10--- 06:34 雪は小ぶりになってますね。・・・(カラスの鳴き声、第一船着き場にて) ---Episode 11--- 07:29 (ハナミズキの赤い実に白い雪が積もっている) 実の上にも雪が・・・積もってますね。なんだったけ。名前が出てこない。 08:03 最近、日がなくなったから。いやー。(心理不明、樹木はタブノキ) ---Episode 12--- 08:09 さあ、第一ベンチですね。第一船着き場から第一ベンチ。 08:15 クスノキがあって、夾竹桃ですね。 08:19 雪の夾竹桃っていうのを、・・・うん・・・速報しないといけない。 ---Episode 13--- 08:52 さあ、(川向こうの西岸に)鳥がいますよ。 09:09 さあ、もう、ここは、・・・第二船着き場を・・・・・・通り過ぎて。 ---Episode 14--- 09:22 ああ、カラスがいるかな。 09:27 楠木にカラスが・・・ 09:31 第二ヤマモモですね。 ---Episode 15--- 09:39 うわー、これはカラスじゃないな。 10:06 何でしょう、これ。(ムクドリ?) 10:52 ちょっと、はっきり見えませんね。 ---Episode 16--- 11:14 近づいて行きましょうか。 12:39 暗いんですよね、鳥が。うーん。 ---Episode 17--- 12:58 はい、目視で。 13:05 よく見て。 13:23 お腹は白いですね。白、灰色。頬が白い。 ---Episode 18--- 13:29 飛んで いきました。 ---Episode 19--- 14:29 ああ、何なの。 14:31 1、2、3、4、5、6、7、8、9、10、11、12、13。 14:37 13羽いました。 14:39 私に驚いて、 14:41 逃げて行きました。 14:44 お邪魔しました。 ---Episode 20--- 14:52 サルスベリですね。 15:00 そうだ、タブノキだ。これはタブノキですね。さっきのもタブノキ。 15:32 鳥がいるような感じですね。 ---Episode 21--- 15:34 第三船着き場ですね。 15:44 煙ってますね。駅の方も。 ---Episode 22--- 16:35 あー鳥じゃないか。 16:50 クスノキ。 16:56 これが鳥にちょっと見えたんですね。 ---Episode 23--- 17:03 第四船着き場ですね。 17:41 第三ベンチですね。 ---Episode 24--- 17:56 鳥が、鵜がいってますね。 18:02 ちょっと望遠ができないな。 18:05 ずーっと行ってます。 18:07 平野橋の下を通って、 18:20 飛んでいきましたね。 18:29 雪だとて、 18:35 川面を飛びます。 18:43 川面を飛ぶ。 18:45 と、 18:46 川面を飛びます。 18:50 鵜の姿。 18:53 一句読めましたか。 ---Episode 25--- 19:06 さて、 19:08 第五船着き場。 ---Episode 26--- 19:39 今季最強寒波っていうのが、 19:43 昨日、 19:44 youtubeのニュースで 19:47 出てましたけど、 ---Episode 27--- 19:49 あー・・・あー 19:54 さっきのかな、1、2、3、4、5、6、 19:57 7、8、9、10、11、12、13羽だな。 20:00 13羽だな。 20:02 また元のところに戻っていってる。 ---Episode 28--- 20:08 (遊歩道を前進) ---Episode 29--- 20:30 椿も、 20:36 完全に、 20:38 花はまあ、花はちょっと見えますね。 20:41 見えますけどね。 20:51 これは桜ですね。 20:53 おっとっと、 20:55 引っ掛かっちゃった。 ---Episode 30--- 21:02 さあ、第六船着き場ですね。 21:14 あ、いましたね。 21:29 あー、・・・ハクセキレイだね、これは。 21:36 撮れなかったかな。 21:41 ハクセキレイでした。 22:05 三種類目ですね。 ---Episode 31--- 22:12 また、強まってきましたね、雪が。 22:23 降る時も、もう、 22:28 このビルが、 22:30 このタワービルが見えませんでしたからね。 ---Episode 32--- 22:37 さあ、 22:45 ソテツも、白くなった。 22:49 第二椿も、 22:56 花水木も、 23:11 あ、第三椿が、 23:15 赤い花を、 23:18 ちょっと咲いてそうか。 23:23 第三椿、冬景色。 23:27 人間ズームレンズ、 23:33 アジサイ。 23:35 第三山桃ですね。 ---Episode 33--- 23:38 踏みしめる音。 23:45 なぜあそこだけ、 23:53 あれかな。雪を積もってるのかな。 23:57 うーん、山桃の影になってる。 ---Episode 34--- 24:02 さあ、あ、あれはなんだろう。 24:19 いましたね。 24:26 イソシギか何か。 ---Episode 35--- 24:33 第七船着き場です。 24:50 さあ、どうなるんだろうね、今日は。 ---Episode 36--- 24:57 冬の北極振動っていうのがあって、 24:59 冬じゃない、 25:01 負の、ネガティブに、 25:03 北極振動っていうのがあって、 25:08 これは、あの、 25:15 北極圏が、高気圧、どちらかと言うと高気圧になって、 25:19 中緯度付近が低気圧になる。 25:22 そうすると、あの、ジェット気流が、 25:26 蛇行し始めるんですね。 25:29 まあ、偏西風、偏西風が蛇行し始めて、 25:33 そう、蛇行したところからこう、 25:36 北極の寒気が漏れてくるっていう、 25:41 ことなんだそうです。 25:45 まあ、これまで、偏西風が蛇行するっていう表現は、よく聞いてたんですけど、 25:49 負の北極振動という言葉が、 25:51 最近出てきたので、 25:53 何のことかなと思って、 25:55 まあ、ジェミニ3と、 25:57 対話したんですけどね。 25:59 そんなことで、ちょっと、 26:04 教えてもらいました。 ---Episode 37--- 26:08 さあ、これ、あれも鵜だな。 26:11 だと思うんだけど、 26:13 飛んでいきますね、 26:15 頑張って、上空を。・・・・・・さあて ---Episode 38--- 26:44 第8、ああ、ハクセキレイ、いましたね。 ---Episode 39--- 27:01 (雪のハクセキレイ、第八船着き場石段にて) ---Episode 40--- 28:38 見えなくなりましたね。

やれやれ、いろいろ配信体制を整えるのに大変。これまで経験上把握していたことをGemini3にぶつけて配信の最適化と自動化を計る。知らないことも多いが、経験から推定していたことは合っている。徐々に最適化・自動化していこう。

道草176プレエピソード2で6本のショートのアップロードの自動化を試してみる。その前提条件を整えないと。面倒だな。プログラミングするとその前提に束縛されてしまう。

プレエピソード1

サザンカ、サザンカ咲いた道

プレエピソード2

https://youtu.be/YEzV1dSyO2E 00:08 行きましょう、 00:29 太陽、日陰と言うか、日陰と言ってもおかしい、雲があるから日陰なんで、この日陰は日陰なんですけど、 00:39 太陽光線が届いてるんですね、そこは溶けちゃう。 00:51 さあ、今日は、文学フリマがあるという話なんで、 01:00 産業会館ですね、ちょっと早めに出てきました、4時までなので、さて、 01:30 どこであるのかな、ありゃりゃ、比治山も霞んでますね、雪で、 02:09 さて、急に降り出したんですかね、傘を持ってない人も多いんです。 02:18 だから頭に、白く白い、白く雪を積もらせて歩いてる人も、いましたね。うーん 02:54 さて、滑らないように横断歩道を渡って、 03:08 いやいや、すごいね、足が濡れますね。 03:52 さて、どうしょうか、行きましょう、危ない、危ない、危ない、危ない、・・・よいしょ、ほいしょ 04:14 さあ・・・・・・あ、そうか、今日、選挙ですね、選挙も忘れてたな、 04:46 おっとっと、雪がすごい積もってた、外で払ってから、・・・・・・あー・・・・・・さあ 06:07 東展示館なんだ、東展示館であるんです、東展示館でした、 06:47 西じゃない、さあ、ややこしいな、西に行かないといけない。何時かな、4時26分、まだやってる 08:12 さあ、西展示館に来ました、西じゃない、東展示館に来ましたね、 08:20 やれやれ (文学フリマ会場に到着)

一日10本制限(人による)は「多くのYouTubeの制限(投稿制限やリンクの有効化など)は、**「最後にアクションを起こしてから24時間が経過したかどうか」**で判定されます。」ということで、昨日朝少し早めに公開したことが問題だったらしい。ショートエピソードの9から17がほとんど流れなかった。18が少し流れたのはサイトに来ていただいた方のアクセスかもしれない。Gemini3と相談しつつ、削除して何らかの形で再アップロードするかどうかを検討中。

後が滞っているけど、日記なので、順次配信が原則。もちろん、02/28/2026: [日記]道草175などから、通常動画で見ていただくのが本筋ではあるのだが。画像としても横長なので情報量が多いし。

今日予定分は流れ始めた。

問題は動画の分節化と動画全体をショートで配信しようとすることにある。エピソードの数が多くなる。視聴者の方の関心は多様だ。少数派の方も大切にしないと。視聴回数が問題ではない。しかしよく考えよう。

T氏の言及から「どんぐりと山猫」をKindle版の青空文庫で読んだ。作家別作品リスト:宮沢 賢治。「イーハトヴ童話 注文の多い料理店」には次のような作品があるらしい。Gemini3との対話。

宮沢賢治が生前に出版した唯一の童話集『注文の多い料理店』(1924年刊)には、序文のほかに以下の9つの物語が収録されています。

- どんぐりと山猫(今回お話ししていた作品です)

- 狼森と笊森、盗森(おいのもりとざるもり、ぬすともり)

- 注文の多い料理店(表題作。イギリス兵のような二人の紳士が山奥の西洋料理店「山猫軒」に入るお話)

- 烏の北斗七星(戦争をテーマにした、カラスの艦隊の悲しくも美しい物語)

- 水仙月の四日(雪の童子や雪狼が登場する、幻想的な冬の物語)

- 山男の四月(山男が薬売りにだまされて黄金を飲まされる、少し不思議なお話)

- かしわばやしの夜(かしわの木たちが踊り出す、音楽的な魅力のある物語)

- 月夜のでんしんばしら(軍隊のように行進する電信柱たちのユーモラスな歌が印象的)

- 鹿踊りのはじまり(ししおどり。自然と人間が心を通わせる瞬間を描いた作品)

この童話集は、副題に「イーハトヴ童話」とある通り、賢治の心の中の理想郷を舞台にした物語が詰まっています。

物語の現れる順序は、青空文庫の宮沢賢治 『注文の多い料理店』新刊案内によれば少し違う(注文の多い料理店 - Wikipediaと同じ)。3と4が入れ替わる。序は、青空文庫の宮沢賢治 『注文の多い料理店』序にある。

W氏によれば、中原中也もオノマトペを使っている。作家別作品リスト:中原 中也。

まさにその通りです!中原中也と宮沢賢治は、日本の近代文学において**「オノマトペを単なる擬音ではなく、魂の震えとして定着させた」**双璧と言えます。

鷲田清一さんの現象学的な視点で見ると、二人のオノマトペの使い方には面白い共通点と違いがあります。

### 1. 中也のオノマトペ:身体と悲しみのリズム

中也の詩に出てくるオノマトペは、賢治が「外なる自然」に向けたものに対し、自分の**「内なる身体感覚」や「やるせなさ」**に深く沈み込んでいくような響きが特徴です。

* **「ゆあーん ゆよーん ゆやゆよん」**(『サーカス』)→ 空中ブランコの揺れを表現していますが、それは単なる視覚的な揺れではなく、見ている側の不安や陶酔といった**心の揺れ**そのものを記述しています。

* **「汚れつちまつた悲しみに/今日も小雪の降りかかる」** → ここには直接のオノマトペはありませんが、中也の詩全体に漂う「さらさら」「しんしん」といった質感は、彼が世界をどう「肌」で感じていたかを雄弁に物語っています。

### 2. 賢治と中也の対比

二人のオノマトペを比較すると、その世界観の違いが際立ちます。 特徴 宮沢賢治(現象としてのオノマトペ) 中原中也(情念としてのオノマトペ) **対象** 風、雲、星、地質など**「外なる宇宙」** 倦怠感、悲しみ、酒、空などの**「内なる風景」** **質感** 結晶、電気、硬質な響き(パチパチ、キィン) 液体、重力、柔らかい溶融(ゆあーん、とろとろ) **役割** 自然界の「声」を人間界に翻訳する 煮え切らない感情を「リズム」へと逃がす ### 3. 「オノマトペの現象学」的な繋がり

鷲田清一さんの議論に引き寄せるなら、二人とも**「意味が固定される前の、生(なま)の感覚」**を言葉にしたかったのでしょう。

* 賢治は、イーハトヴの山々で聞いた**「アドレッセンス中葉」の森のざわめき**を。

* 中也は、都会の片隅で感じた**「空虚な自己の震え」**を。

二人はほぼ同時代人ですが、賢治は「科学と宗教」を、中也は「象徴詩とダダイズム」を背景にしていました。しかし、どちらも**「既存の言葉では自分の感じているこの世界(現象)を捉えきれない!」**という切実な飢えから、新しいオノマトペを創造せざるを得なかったのだと思います。

---

読書会で「オノマトペは身体の延長である」といった話が出たのであれば、中也の「ゆあーん ゆよーん」などは、まさに三半規管が狂うような感覚を読者に追体験させる、最も成功した例かもしれませんね。

中也の詩の中で、ほかにリズムや響きが気になったフレーズはありますか?それとも、賢治と中也の「イーハトヴ」と「都会」という舞台の違いに興味がありますか?

更新日記 - 日曜プログラマのひとりごと

更新日記 - 日曜プログラマのひとりごと